'이루다'로 불거진 AI 윤리논란…정부, '인력성별 균형' 권고

![인공지능 챗봇 '이루다' [이루다 페이스북 캡처. 재판매 및 DB 금지]](https://img.hankyung.com/photo/202109/01.27521636.1.jpg)

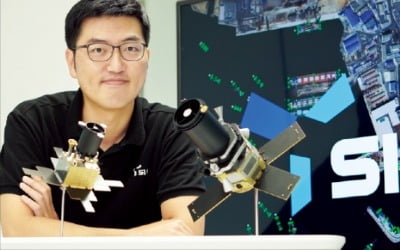

이루다는 '지하철 임산부석'을 말하자 "그 단어 혐오스럽다"고 답했고, 레즈비언에 대해서는 "너무 싫다, 소름끼친다"고 했다. 이루다가 데이터를 학습하는 과정에서 각종 사회적 편견과 혐오도 함께 습득한 결과였다.

이와 관련해 정부가 "AI가 사회적 편견과 차별을 재생산하지 않도록 구체적인 윤리기준과 관련 산업 인력에도 성별 균형이 필요하다"고 권고했다. 16일 여성가족부는 2020년 특정성별영향평가를 한 결과 인공지능(AI) 기술 연구 등 10개 정책에 대해 관계부처에 개선을 권고했다고 밝혔다.

특정성별영향평가는 정부 정책에 대해 성평등 관점에서 평가하고 개선을 권고한다. 권고받은 부처는 30일 안에 개선계획을 수립해 여가부에 제출하고 법령 개정과 제도 개선 등 필요 사항을 이행해야 한다.

여가부는 AI 학습용 데이터 기획·구축 과정에서 성별 등 다양성을 반영해야야 한다고 지적했다. 이를 위해 AI 분야 인력의 성별 다양성을 지금보다 높일 것을 권고했다. 과학기술정보통신부의 2020년 소프트웨어산업 실태조사에 따르면 AI 사업 추진 기업의 소프트웨어 전문인력 여성비율은 19.1%로 나타났다. AI 사업 추진 기업 대표자 여성 비율은 3.1% 정도다.

여가부 관계자는 "AI 개발은 사람이 하는 것이고, AI가 사람의 역할을 대신하는 만큼 산업 내 인력 다양성에 초점을 맞췄다"며 "향후 성별을 포함해 사회적 다양성을 고려한 개발되도록 공론회장을 만드는 등 다양성을 반영하도록 제안할 예정"이라고 말했다.

AI 윤리규정에 대해서도 "사용자 입장에서 활용이 가능하도록 보다 구체화해야 한다"고 강조했다. 지난해 12월 4차산업혁명위원회에서 확정된 AI 윤리규정에 대략적인 원칙과 요건이 제시됐지만 개발자, 이용자 등 세부 주체들이 활용할 수 있는 부분은 미흡하다는 지적이 나온 데 따른 것이다.

최다은 기자 max@hankyung.com

-

기사 스크랩

-

공유

-

프린트

!["버핏, 애플 팔고 '9조' 베팅한 곳이…" 6개월 만에 깜짝 공개 [대가들의 포트폴리오]](https://timg.hankyung.com/t/560x0/photo/202405/01.36729398.1.jpg)

![최강창민 '늦바람' 들게 한 '벤자민 버튼'…"삶 아름답게 정의해드립니다" [종합]](https://timg.hankyung.com/t/560x0/photo/202405/ZA.36735186.3.jpg)