AI 시대…HBM이 메모리 판 바꾼다

-

기사 스크랩

-

공유

-

댓글

-

클린뷰

-

프린트

HBM, 5배 비싸지만 주문 몰려…삼성·SK 앞다퉈 증설

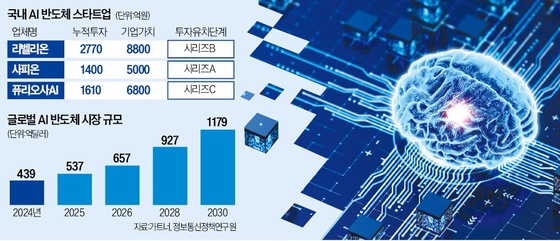

31일 반도체업계에 따르면 맞춤형 D램의 대표적 사례로 고대역폭메모리(HBM)가 꼽힌다. HBM은 D램을 수직으로 4단, 8단 등으로 쌓고 연결해 데이터 처리 용량·속도를 일반 D램 대비 열 배 이상으로 높인 제품이다.

지난해 12월께부터 세계적으로 챗GPT로 불리는 생성형 AI 열풍이 불면서 HBM 수요가 급증하고 있다. 생성형 AI의 서비스를 고도화하기 위해서는 대규모 언어 데이터를 빠르게 학습하고 처리할 수 있는 반도체가 필수적이다. 업계에서 연산용 칩으로 그래픽처리장치(GPU), GPU를 보조할 데이터 저장장치로 HBM이 낙점받았다.

피터 리 씨티글로벌마켓증권 반도체본부장은 “AI 기술 확산으로 올해 HBM이 전체 D램 매출에서 차지하는 비중은 11%에 달할 것”이라며 “2025년에 HBM이 전체 D램 매출의 27%, 2027년에는 30%를 차지할 것”이라고 전망했다. 공급이 수요를 못 따라가면서 삼성전자, SK하이닉스는 내년 말까지 총 2조원 이상을 HBM 증설에 투자할 계획이다.

HBM이 끝이 아니다. 앞으로는 D램에 중앙처리장치(CPU) 같은 연산 기능이 더해지면서 메모리반도체가 CPU, GPU를 제치고 AI 반도체산업의 중심에 서게 될 것이라는 전망이 나온다. 최근 삼성전자와 SK하이닉스는 D램에 일부 CPU 기능을 추가한 ‘PIM(processing in memory)’이라고 불리는 차세대 제품을 개발했다.

황정수/김익환 기자 hjs@hankyung.com

-

기사 스크랩

-

공유

-

프린트

![[단독] 새마을금고 '초비상'…124곳에 '부실 딱지'](https://timg.hankyung.com/t/560x0/photo/202406/AA.37001326.3.jpg)