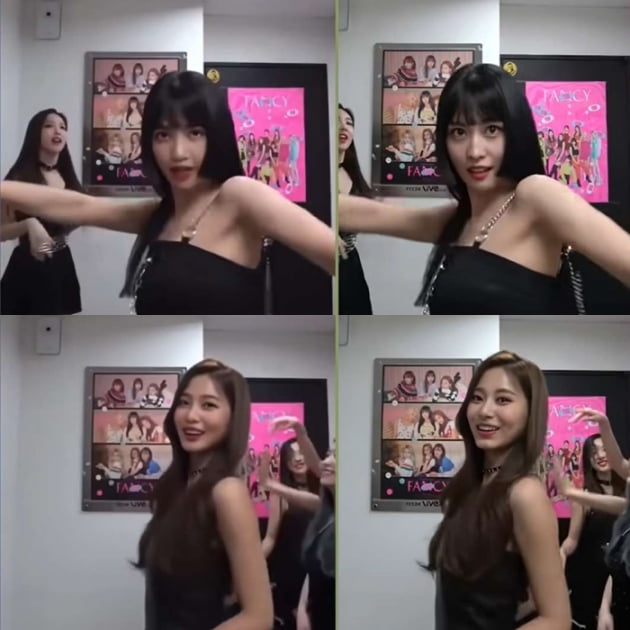

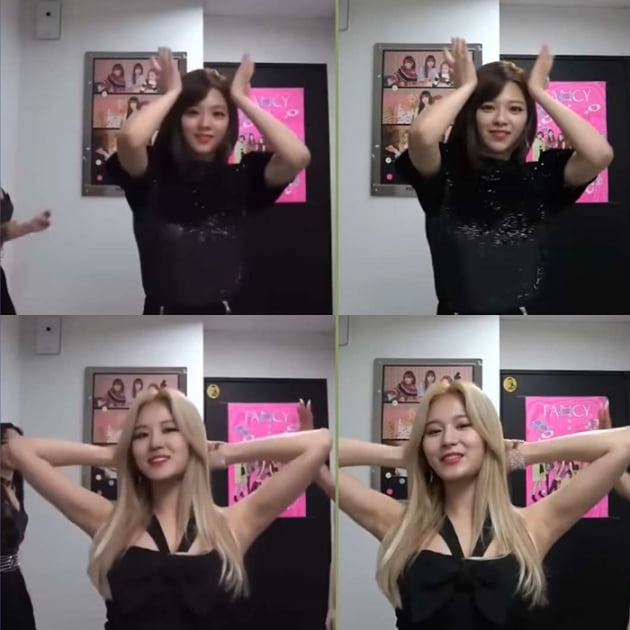

최근 한 K팝 전문 유튜브 채널에서 트와이스 멤버들이 추는 '팬시'(Fancy)에 딥페이크 기술을 써서 레드벨벳, 블랙핑크 멤버들의 얼굴로 만든 영상을 공개했다. 고정된 화면이 아닌 쉼 없이 빠르게 움직이는 영상에서도 이질감 없이 보여지는 딥페이크 영상에 "충격적"이라는 반응이 이어지고 있다.

영상을 본 사람들은 "생각보다 너무 자연스러워서 놀랍다", "이 정도면 악용될 경우 엄한 사람이 여럿 당할 수도 있겠다", "얼굴이 정확히 알려진 사람들도 이렇게 자연스러운데, 비연예인을 상대로 하면 더 큰일날 거 같다", "소름돋고 무섭다"는 댓글이 쏟아졌다.

네덜란드의 사이버 보안업체인 '딥트레이스'(Deeptrace)의 연구 결과를 소개한 보도에 따르면 2018년 12월 기준 7964개였던 딥페이크는 9개월 만에 1만4698개까지 급증했고, 발견된 딥페이크의 96%가 음란물이었다. 음란 딥페이크 피해자 중 25%는 한국 여성 연예인인 것으로 나타났다.

국내에서도 지난해 3월 연예인 얼굴을 딥페이크로 만든 음란물을 공유했던 텔레그램 단톡방이 적발돼 충격을 안겼다.

올해 2월 청와대 국민청원 게시판에는 '여성 연예인들을 고통받게 하는 불법 영상 '딥페이크'를 강력히 처벌해주세요'라는 제목의 청원글이 올라왔다.

청원인은 "여성 연예인들이 딥페이크라는 기술에 고통받고 있다"며 "이 기술을 사용하면 성인 비디오에 등장하는 여성의 얼굴을 특정 연예인 얼굴로 바꿀 수 있다. 구글, 트위터 등 쉽게 검색할 수 있을 뿐만이 아니라 수많은 사이트가 생성되어 가고 있다"고 주장했다.

딥페이크 사이트, 이용자들의 강력과 처벌과 수사를 촉구하는 청원에 하루가 되지 않아 답변 최저 인원 20만 명 이상의 동의를 얻었고, 39만415명의 참여로 마감됐다.

이에 정부는 "딥페이크 기술 등을 악용해 불법합성물을 제작해 반포하는 행위는 명백한 범죄행위"라며 "지난해 6월 성폭력처벌법이 개정되면서 관련 규정이 신설된 후 처벌이 가능해졌으며, 경찰은 딥페이크 기술을 악용한 불법합성물 근절을 위해 지난해 12월부터 '허위영상물 제작·유포사범 집중단속'을 실시 중"이라고 밝혔다.

그러면서 "딥페이크 기술 악용 등으로 인한 피해자 지원도 더욱 적극적으로 임하겠다"며 "디지털성범죄피해자지원센터를 24시간 운영하여 피해자는 물론 부모, 가족에 대한 심리 치료를 지원하고, 피해 영상물이 더 이상 확산되지 않도록 적극 삭제하고 있다"고 전했다.

김소연 한경닷컴 기자 sue123@hankyung.com

기사제보 및 보도자료 newsinfo@hankyung.com