"中 남자와 결혼할래요"…미녀 인플루언서 실체에 '패닉' [조아라의 IT's fun]

-

기사 스크랩

-

공유

-

댓글

-

클린뷰

-

프린트

[조아라의 IT's fun] 55

구독자 30만 슈퍼 인플루언서에 속았다

가짜 판명에 '발칵'

"세상에 이런 일이…소름 끼친다" 진짜 주인공 패닉

바이든 "투표하지 마"…경선 앞두고 '딥페이크' 기승

구독자 30만 슈퍼 인플루언서에 속았다

가짜 판명에 '발칵'

"세상에 이런 일이…소름 끼친다" 진짜 주인공 패닉

바이든 "투표하지 마"…경선 앞두고 '딥페이크' 기승

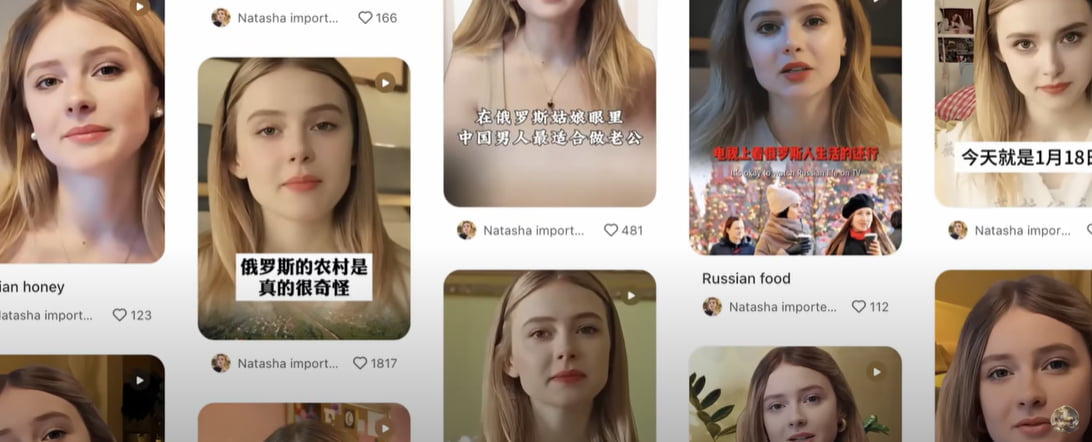

금발 미모의 여성 '에이프릴'이 중국판 인스타그램 샤오훙수에서 유창한 중국어로 "중국에서 8년 살았다"며 친중(親中) 발언을 쏟아내고 있다. 또 다른 샤오훙수 계정 '나타샤의 수입과자점'엔 구독자 수 30만명의 러시아인 '나타샤'가 러시아 과자를 소개하고 판매한다. 영상 수준은 제법 훌륭하다. 봉지를 뜯어 '오도독' 깨물어 먹는 소리까지 풍부한 ASMR(자율 감각 쾌락 반응)을 담았다. 설날 접대용 사탕 영상은 '좋아요'만 11만개 이상이다.

"세상에 이런 일이...소름 끼친다" 진짜 주인공 패닉

중국에서 활동하는 '에이프릴'과 '나타샤'는 러시아 국적으로 중국에 거주하며 파워 인플루언서로 활동하고 있다. 샤오훙수에는 이런 나타샤들이 수십명 검색된다. 친중 발언을 거침없이 내뱉으면서 우호적인 여론을 형성하고 식음료 또는 패션 상품을 판매하고 있다.

영상 속 실제 인물은 우크라이나 국적의 올가 로이에크(Olga Loiek)라는 젊은 여성이다. 로이에크는 지난달 말 자신의 유튜브 채널에 "한 누리꾼이 준 메시지를 읽고 깜짝 놀랐다"며 "사실 내 영상이 중국에 퍼진 건 이미 알고 있었던 사실이라 별로 신경 쓰이지 않았는데, 그가 준 링크를 눌러 확인했을 땐 정말 충격적이었다. 가짜 복제인간이 한둘이 아니었다"고 밝혔다.

바이든 "투표하지 마"…경선 앞두고 '딥페이크 전화' 기승

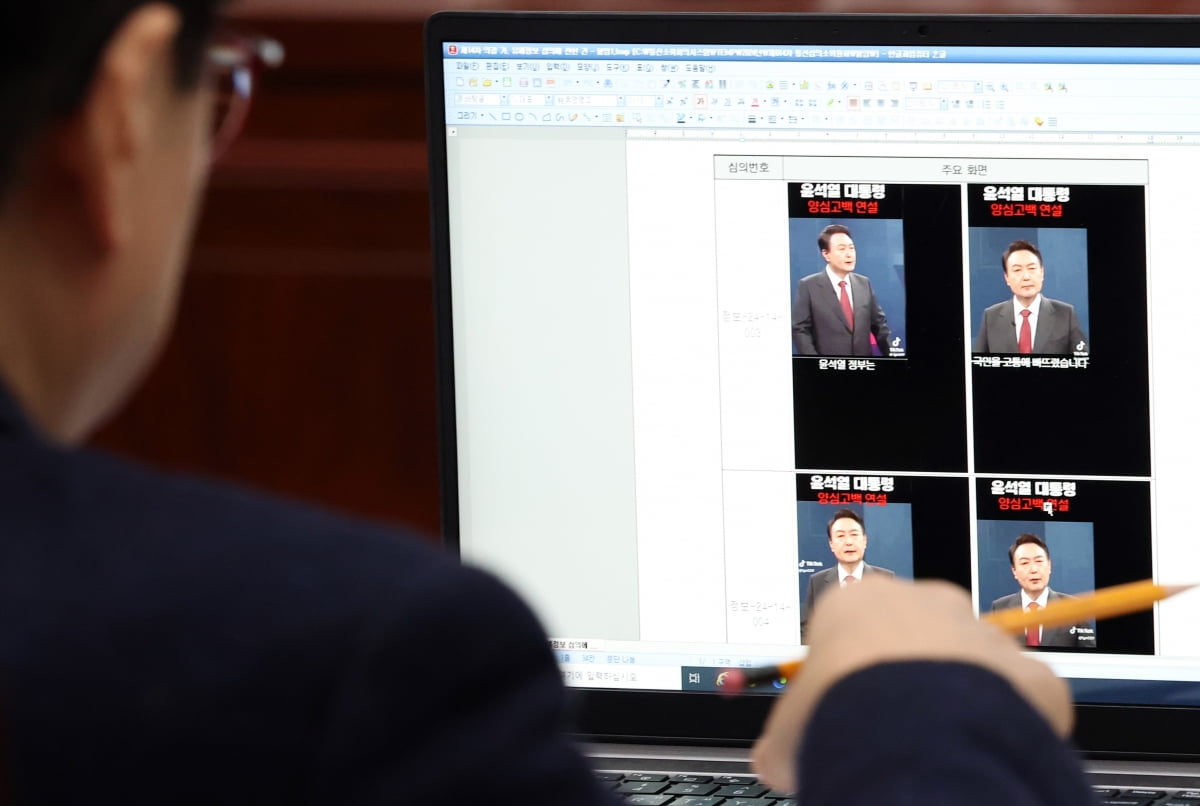

특히 올해는 세계적으로 중요한 선거가 많아 정치권에서 'AI 리스크'는 심화할 것으로 예상된다. 과거에는 주로 여성 및 아동에 음란물을 합성한 성착취물이 논란이 됐으나, 최근에는 연예인이나 유명인, 정치인 등을 합성해 사기에 이용하는 사례가 늘어나는 추세다.

미국의 경우 지난 1월23일 뉴햄프셔주 프라이머리(예비선거)를 앞두고 조 바이든 대통령을 사칭, 경선 불참을 조장하는 딥페이크 음성이 유포돼 논란이 됐다. 전화는 "진짜 헛소리네" 등 바이든 대통령이 자주 사용하는 말투를 흉내냈다. 뉴햄프셔주 검찰은 "바이든 대통령 목소리처럼 들리지만, 이 메시지는 인공적으로 생성된 것으로 보인다"며 "오인하지 말라"고 당부했다.

선거일이 가까워질수록, 딥페이크 조작 영상은 더욱 기승을 부릴 것으로 예상된다. 네이버는 딥페이크와 관련된 검색 결과에 '경고 문구'를 붙이는 방안을 추진 중이다. 카카오는 AI 자회사 카카오브레인이 생성 AI 모델 ‘칼로’에 비가시성 워터마크 기술 도입을 검토하고 있다.

인스타그램을 운영하는 메타의 한 관계자는 "AI 딥페이크 조작물의 확산을 막기 위해 커뮤니티 정책을 위반하는 조작된 미디어를 삭제하고, 허위 또는 변형된 콘텐츠라고 판명된 게시물에 라벨을 붙이는 등 다방면의 조치를 취하고 있다"고 설명했다.

ADVERTISEMENT

ADVERTISEMENT

![똑닮은 손석구 아역·부활한 송해…'진짜 같은 가짜' 괜찮을까? [연계소문]](https://img.hankyung.com/photo/202402/01.35929412.3.jpg)

![불붙은 '비트코인ETF' 공약…'맞대결' 여야에 당국 눈치 [이민재의 쩐널리즘]](https://img.hankyung.com/photo/202402/B20240223164637600.jpg)

![K팝 업계에도 '친환경' 바람…폐기물 되는 앨범은 '골칫거리' [연계소문]](https://img.hankyung.com/photo/202206/99.27464274.3.jpg)