정치권까지 확산된 딥페이크…"가이드라인 필요"

-

기사 스크랩

-

공유

-

댓글

-

클린뷰

-

프린트

<앵커>

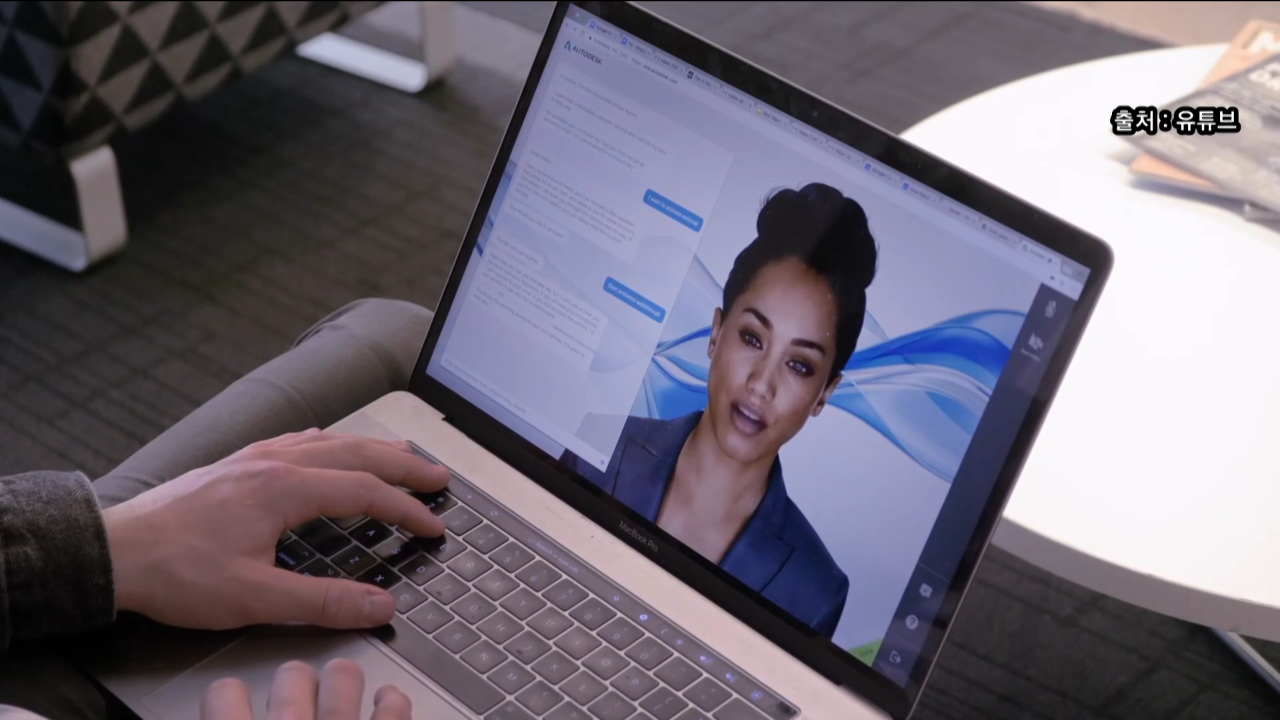

인공지능을 활용해 진짜와 비슷한 가상인물을 만들어 내는 딥페이크 기술이 산업 전반으로 확산되고 있습니다.

최근엔 대선후보들까지 나서 자신의 모습을 본 딴 AI 가상인물을 만들어 선거운동에 활용하겠다고 밝히면서 다시 한 번 주목을 받고 있는데요.

잘못 사용하면 치명적인 부작용을 초래할 수 있는 만큼 딥페이크 활용 범위에 대한 명확한 기준이 필요하다는 지적이 나오고 있습니다.

양현주 기자가 취재했습니다.

<기자>

[AI윤석열 : 안녕하세요 AI 윤석열입니다. 윤석열 후보와 너무 닮아 놀라셨습니까.]

[AI김동연 : 김동연 대통령 예비후보 아바타 윈디입니다. 저 윈디는 김동연 후보의 철학과 비전을 공유할 겁니다.]

윤석열 국민의힘 후보, 김동연 전 경제부총리 등 대선 주자들이 딥페이크 기술을 활용한 아바타들을 잇달아 내놓고 있습니다.

몸이 열 개여도 부족한 대선 정국에서 자신의 분신인 아바타를 선거운동에 적극 활용하겠다는 취지입니다.

다양한 분야에서 가상인물이 인기를 끌고, 관련 앱이 앱마켓 상위 랭킹을 차지할 정도로 딥페이크 기술은 이미 우리 일상 깊숙이 자라 잡았습니다.

하지만 정치권이 선거기간 중 딥페이크 기술을 활용하는 데 대해서는 부정적인 의견이 우세합니다.

후보자의 조작된 이미지가 유포될 경우 유권자의 눈을 흐릴 수 있다는 이유에서입니다.

실제로 지난 2017년 미국 대통령 선거 기간 중, 버락 오바마의 모습을 본뜬 가짜 영상이 트럼프 후보에게 욕설을 해 화제가 되기도 했습니다.

[AI오바마: 간단히 이렇게 말해볼까요. 트럼프 대통령은 아주 완전히 머저리입니다]

이런 문제 때문에 EU에선 딥페이크를 허위정보 관련 법으로 규제하고 있고, 미국에선 딥페이크 영상 업로드 시, 반드시 이를 표시하도록 하고 있습니다.

하지만 국내에선 이 같은 악용 사례를 제지할 방법은 없습니다.

딥페이크 산업을 활성화하면서도 부작용을 최소화하기 위해선 각 분야별로 구체적인 가이드라인이 필요하다는 목소리가 나오는 이유입니다.

[전창배 / 한국인공지능윤리협회 이사장: 향후에는 분야별로 인공지능 가이드라인이 세분화돼서 체계화될 필요가 있다고 봅니다. 정치, 경제, 사회 분야에서 각각 맞는 가이드라인이 있거든요. 각 분야의 전문가들, 정부, 기업, 학계, 시민사회가 모여 어떤 가이드라인이 필요한지 논의하고 합의하는 과정이 필요할 거라 생각합니다.]

한국경제TV 양현주입니다.

양현주기자 hjyang@wowtv.co.kr

![K팝 업계에도 '친환경' 바람…폐기물 되는 앨범은 '골칫거리' [연계소문]](https://img.hankyung.com/photo/202206/99.27464274.3.jpg)