[Global CEO & Issue focus] 인공지능의 자율성에 대한 고민

진석용 < LG경제연구원 책임연구원 syjin@lgeri.com >

![[Global CEO & Issue focus] 인공지능의 자율성에 대한 고민](https://img.hankyung.com/photo/201609/AA.12607883.1.jpg)

그동안 금융시장의 투자자로서 인간과 경쟁하고, 국방분야에서 정보 분석 업무를 다루는 등 특수한 분야에서만 활동하던 인공지능이 이제는 대중적인 영역에도 진출하고 있다. 언론분야에서 스포츠, 날씨 기사를 작성하는 기자로 활동하기도 하고 법조계에서는 판례 조사와 분석 업무를 맡기 시작했다. 퀴즈쇼 우승으로 유명한 IBM의 왓슨은 진단 능력을 보강해 의료 시장 진출을 꾀하고 있다.

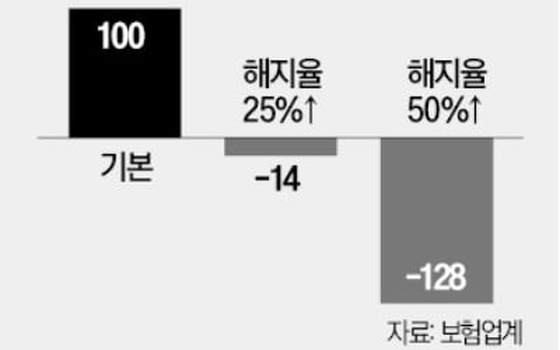

이렇게 활동 범위가 넓어지면서 인공지능의 각종 부작용에 대한 우려도 커지고 있다. 그중 하나는 인공지능의 자율성 수준, 즉 인간이 얼마나 개입할 것인지에 대한 고민이다. 인공지능에 의사 결정을 맡기는 것이 반드시 좋은 결과를 보장하지는 않기 때문이다. 인공지능의 자율적 판단은 2010년 미국 증시 폭락이라는 예기치 못한 초대형 사고를 초래한 바 있다. 거래 권한을 위임받은 인공지능이 서로 경쟁한 결과 증시 규모의 10분의 1인 약 1조달러가 불과 5분 만에 사라져버렸다. 2003년 이라크전 당시 미군의 패트리엇 미사일 시스템은 아군 전투기들을 연달아 격추하는 실수를 저지르기도 했다.

일각에서는 인간과 인공지능 간 의견 충돌도 다양한 양상으로 발생하리라 본다. 탑승자가 자율주행 자동차의 운전 성향을 못마땅해할 수도 있다. 진단 결과를 둘러싸고 의사와 인공지능 간 의견 충돌이 생길 수도 있다. 효율적인 목적 달성에만 집착하는 인공지능은 전쟁터에서 민간인 피해를 거리끼지 않을 수도 있다.

이 때문에 최근 인공지능이 인간 사회의 가치관과 법칙을 존중하도록 만드는 것이 중요한 현안으로 부각되고 있다. 인간과 인공지능 중 누구의 의견을 따라야 할지 판단할 수 있는 기준에 대한 필요성도 제기되고 있다. 이러한 요구에 부응해 인간 사회의 질서를 깨뜨리지 않는 인공지능 개발에 초점을 둔 학구적 노력과 유사시 갈등 해소의 틀을 마련하려는 실무적 노력도 진행되고 있다.

공학자들은 개발 단계에서부터 인공지능의 용도와 영향력을 감안해 인공지능의 자율성 정도를 조절하고, 인간에게 우호적인 성향을 가지도록 알고리즘을 짜거나 인공지능을 학습시키기도 한다. 유사시 인공지능을 멈출 ‘킬 스위치’ 등의 능동적 보호장치도 적용하려 하고 있다.

좀 더 실효성 있는 방안인 관련 법·제도의 정비는 인공지능 개발을 주도하는 선진국 중심으로 이뤄지고 있다. 제도 정비에 대한 논의는 △인공지능과 로봇의 사용 요건 △인간과 인공지능 중 누구의 의견을 따를지 판단하는 기준 △인공지능이 개입된 사고의 책임 소재 등에 집중되고 있다. 인공지능의 재산소유권이나 세금 부담 등도 논의해야 할 과제다.

이처럼 다양한 이슈를 담고 있는 인공지능의 자율성에 관한 논의는 점점 더 활발해질 것이다. 인간이 인공지능에 어느 정도의 자율성을 부여할 것인지는 다양한 사용 경험을 축적하면서 수정, 보완해야 할 과제이기 때문이다.

진석용 < LG경제연구원 책임연구원 syjin@lgeri.com >

-

기사 스크랩

-

공유

-

프린트

![[책마을] "암호화폐는 전세계 금융시장의 가장 뜨거운 광기"](https://timg.hankyung.com/t/560x0/photo/202405/AA.36676420.3.jpg)