이미지·소리 결합해 학습…메타 '다감각 AI' 공개

온도·움직임 등 동시에 분석

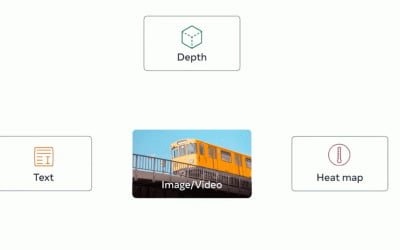

메타는 지난 9일 새로운 오픈소스 AI 모델 ‘이미지바인드’ 연구 논문을 공개했다. 여섯 가지 유형의 데이터를 동시에 분석하고 학습할 수 있다는 게 논문의 골자다. △시각적 데이터(이미지·비디오) △열화상(적외선 이미지) △텍스트 △오디오 △3차원(3D) 심도 △관성 측정(IMUs) 등 6종의 데이터를 결합한 최초의 AI 모델이라는 게 회사 측 설명이다.

이 모델을 활용하면 열대우림, 혼잡한 시장 등에서 얻은 오디오 데이터를 이미지로 바꾸는 등의 시도가 가능하다. 회사 관계자는 “이미지바인드는 사진 속 물체가 어떻게 소리를 내고 3D처럼 보이는지, 얼마나 따뜻하고 추운지, 어떻게 움직이는지에 대한 전체적인 이해를 제공한다”며 “다양한 유형의 데이터로부터 학습하는 멀티모달 AI 시스템을 만들기 위한 노력의 일환”이라고 설명했다.

업계에서는 이미지바인드의 프로젝트가 상용화되려면 시간이 더 필요하다고 내다봤다. 미국의 정보기술(IT) 전문매체 더버지는 “이미지바인드가 몰입형 다감각적 경험을 제공하는 생성AI의 미래”라며 “이미지바인드에 장거리 항해를 구현해달라고 요청하면 파도 소리뿐만 아니라 발밑의 갑판 흔들림과 시원한 바닷바람까지 느낄 수 있게 해줄 것”이라고 평가했다. 메타 관계자는 “앞으로 촉각, 화법, 후각, 자기공명영상(fMRI) 뇌 신호 등 가능한 많은 감각 데이터를 연결할 계획”이라고 말했다.

최진석 기자 iskra@hankyung.com

-

기사 스크랩

-

공유

-

프린트

![하루 만에 550조원 증발…실적·물가 압력에 기술주 투매 [글로벌마켓 A/S]](https://timg.hankyung.com/t/560x0/photo/202404/B20240206081554930.jpg)

![[단독] "경영보다 돈"…아워홈 매각 손잡은 남매](https://timg.hankyung.com/t/560x0/photo/202404/AA.36472890.1.jpg)

![[신간] 로마 제국이 '최고 국가'로 우뚝 서기까지…'팍스'](https://timg.hankyung.com/t/560x0/photo/202404/ZK.36477517.3.jpg)